Verfolge mit uns die neuesten Nachrichten aus der Welt der IT, Software und Hardware. Wir berichten über Produkte von Google, Microsoft, Facebook, OpenAI und mehr. Außerdem informieren wir über IT-Nachrichten der Hardware-Giganten Intel, Nvidia und AMD sowie über Neuigkeiten aus den Bereichen Robotik, Smartphones und Spiele.

Juni 2025

Windows 11 Neuigkeiten erwarten Sie

Microsoft testet neue Optionen in den Kontexteinstellungen des Explorers, wie z.B. die Verknüpfung mit dem Git-Cloud-Repository, die Anzeige von virtuellen Umgebungen (Hyper-V, Windows Sandbox) und erweiterte Grundeinstellungen für die Dateiverwaltung. Bei der Suche wird es Informationen über den Indizierungsstatus von verschiedenen Standorten geben und darüber, ob ein Ordner lokal oder nur online verfügbar ist (z.B. von OneDrive). Der Explorer in der Entwicklerversion enthält außerdem ein Untermenü für KI-Aktionen, das grundlegende Bildoperationen über die Apps Sketchpad und Fotos ermöglicht.

Darüber hinaus ändert Windows 11 die Eingabehilfenleiste, indem es mehr Einstellungen in der schwebenden Leiste und die Qualität der Bildkomprimierung in Windows Share (3 voreingestellte Stufen) anzeigt. Außerdem wird eine verbesserte Logik für den Energiesparmodus eingeführt, der im Leerlauf aktiviert wird und schnell wieder in einen leistungsfähigeren Zustand übergeht, wenn der Benutzer wieder aktiv ist. Alle diese neuen Funktionen sind vorerst im Entwicklerkanal zu finden und ermöglichen es IT-Profis und fortgeschrittenen Nutzern, die Arbeit mit dem System noch detaillierter anzupassen.

Quelle: blogs.windows.com/windows-insider/2025/05/19/announcing-windows-11-insider-preview-build-26200-5603-dev-channel/

Xiaomi bringt ein Smartphone, das nach Kaffee riecht

Xiaomi hat das CIVI 5 Pro in einem speziellen braunen Finish namens Iced Americano vorgestellt, das dezent nach Kaffee riecht und einen exklusiven Eindruck ohne starke Parfümintensität vermittelt. Das Gerät verfügt über einen Snapdragon 8s Gen 4 Chipsatz, ein 6,55 Zoll großes OLED-Display mit einer Bildwiederholfrequenz von 120 Hz, ein schlankes Gehäuse mit einer Dicke von 7,45 mm und einem Gewicht von ca. 181 Gramm in der Kaffee-Version.

Neben Xiaomi versuchen sich auch mehrere Hersteller wie Motorola und Infinix am Trend der parfümierten Smartphones. Das Xiaomi CIVI 5 Pro ist vorerst nur in China erhältlich. Es bleibt die Frage, ob die parfümierte Version auch Europa erreichen wird.

Quelle: androidauthority.com/iced-americano-phone-smells-like-coffee-3560711/

Edge als Tor zu KI-Modellen für Entwickler

Microsoft experimentiert damit, Entwicklern den Zugriff auf Sprachmodelle, insbesondere das Phi-4-mini-Modell (3,8 Milliarden Parameter), über die API durch den Edge-Browser zu ermöglichen. Voraussetzung für die Nutzung dieser Funktionalität ist das Vorhandensein von Microsoft Edge auf dem Gerät, wobei das Ziel eine plattformübergreifende Lösung einschließlich macOS ist.

Die Funktion ist noch experimentell und in den Kanälen Edge Canary und Dev verfügbar. Sie ermöglicht die einfache Integration von KI-Funktionen, wie z. B. Texterstellung oder Zusammenfassung, direkt in Webanwendungen, ohne dass separate Bibliotheken erforderlich sind. Chrome bietet einen ähnlichen Ansatz. Beide Unternehmen konkurrieren also um die Aufmerksamkeit der Entwickler, damit ihr Browser als Tor zu den Modellen und Daten der Nutzer dient.

Quelle: theverge.com/news/669528/microsoft-ai-edge-browser-web-app-build-apis

Opera bereitet einen neuen Browser mit KI vor

Opera bereitet einen neuen speziellen Browser mit KI vor, der als Agent arbeiten wird. Er wird den Nutzern auch fortgeschrittene Optionen für die Bearbeitung von Code, die Erstellung von Apps oder die Verarbeitung von Bildern auf der Grundlage von Textbefehlen bieten. In der Zwischenzeit laufen eine Konzeptpräsentation und eine offene Warteliste mit dem Ziel, den klassischen Browser sowohl für Gelegenheitsnutzer als auch für Experten zu ergänzen.

Es wird erwartet, dass der Dienst auf Abonnementbasis angeboten wird, aber Details zu Preisen und Modellen sind noch nicht bekannt. Opera hat bereits in der Vergangenheit mit KI im Standardbrowser experimentiert, u.a. mit dem unvollendeten Projekt Opera Neon aus dem Jahr 2017, aber dieses Mal handelt es sich um ein eigenständiges Produkt, das sich auf direkt in den Browser integrierte KI-Funktionen konzentriert.

Quelle: operaneon.com

Google Fotos feiert 10 Jahre mit neuem KI-Editor

Google Fotos feiert sein 10-jähriges Jubiläum und zu diesem Anlass hat Google einen überarbeiteten Editor vorgestellt. Dieser vereinigt die Werkzeuge an einem Ort und baut stark auf KI-Bearbeitungsvorschläge für das gesamte Foto oder bestimmte Teile davon. Funktionen wie Reimagine (die Szene verbessern oder verändern) und Auto Frame (einen idealen Ausschnitt vorschlagen und fehlende Teile ergänzen), die bisher nur für Pixel-Geräte verfügbar waren, werden bald für alle Smartphone-Nutzer verfügbar sein.

Ebenfalls neu ist die KI-Verbesserungsfunktion, die automatisch drei verschiedene Bearbeitungsvorschläge generiert (z. B. Schärfen oder Entfernen von Objekten) und der Benutzer wählt seinen bevorzugten Vorschlag aus. Eine weitere neue Funktion ist die gemeinsame Nutzung von Alben über einen QR-Code, mit dem Fotos sofort zwischen Personen in der Nähe ausgetauscht oder hinzugefügt werden können. Google wird den neuen Editor ab Juni für Android (beginnend mit Version 8) einführen und eine iOS-Version wird später im Jahr verfügbar sein.

Quelle: androidauthority.com/10-years-google-photos-never-looking-back-3561775/

Play Store bietet einen KI-Assistenten, der Fragen zu Apps beantwortet

Google hat damit begonnen, nach und nach die Möglichkeit zu integrieren, Fragen an die Gemini-KI direkt im Profil der App im Play Store zu stellen. Die Nutzer sehen einen Bereich für die Interaktion mit der KI, in dem sie Informationen über die Nutzung der App, Einstellungen oder Regeln erhalten können, ohne anderswo nach Antworten suchen zu müssen.

Die Funktion ist vorerst in der experimentellen Version des Play Store 46.1.39-31 verfügbar und wird nach und nach für ausgewählte Nutzer eingeführt. Gemini wird auch FAQs vorschlagen, was die Navigation erleichtert und Zeit spart. Da die Antworten von der KI generiert werden, sind sie möglicherweise nicht immer korrekt, so dass es empfehlenswert ist, sie zu überprüfen. Der KI-unterstützte Bereich wird nur in Apps angezeigt, über die Gemini ausreichend Informationen hat, und bietet den Nutzern einen Assistenten, der ihnen bei der Navigation und dem Verständnis der Funktionen der Apps hilft.

Quelle: androidauthority.com/google-play-store-ask-play-about-this-app-rolling-out-3562259/

Das KI-Startup Builder.ai setzte 700 indische Ingenieure ein, um die

Das in London ansässige Unternehmen Builder.ai, das sich als KI-gestützte App-Entwicklungsplattform präsentierte, ist zusammengebrochen, nachdem entdeckt wurde, dass es in Wirklichkeit rund 700 indische Ingenieure beschäftigte, um Aufgaben, die der KI zugeschrieben wurden, manuell auszuführen.

Das Startup hat außerdem Round-Tripping mit VerSe Innovation betrieben und fiktive Dienstleistungen in Rechnung gestellt, um den Umsatz künstlich zu steigern, wodurch der tatsächliche Umsatz von 45 Mio. $ auf 180 Mio. $ für das Jahr 2023 aufgebläht wurde. Nachdem einer der wichtigsten Kreditgeber, Viola Credit, 37 Mio. $ aufgrund von Verstößen gegen die Kreditbedingungen und der Nichtbezahlung von Mitarbeitern zwangsvollstreckt hatte, meldete der CEO Konkurs an. Der Fall verdeutlicht die Risiken von Investitionen in Startups, die ihre technologischen Fähigkeiten überschätzen und es versäumen, für Transparenz zu sorgen.

Quelle: business-standard.com/companies/news/builderai-faked-ai-700-indian-engineers-files-bankruptcy-microsoft-125060401006_1.html

IBM plant die Entwicklung eines Starling Quantencomputers mit bemerkenswerter Leistung

IBM hat einen ehrgeizigen Plan angekündigt, bis 2029 den Quantencomputer Starling zu entwickeln, der über 200 logische Qubits verfügen und bis zu 100 Millionen Quantenoperationen durchführen kann. Das Unternehmen sagt, dass die Simulation einer solchen Maschine auf klassischen Supercomputern eine Quintillion leistungsstarker Geräte erfordern würde, was das enorme Potenzial des Quantencomputers verdeutlicht.

Die Entwicklung erfolgt schrittweise. Bereits in diesem Jahr sollen der Nighthawk-Chip und die Quantum Loon-Plattform vorgestellt werden, um den ersten echten Quantenvorteil zu zeigen. Ein modularer Kookaburra-Chip für Skalierbarkeit soll 2026 auf den Markt kommen und ein Cockatoo-Chip, der mehrere Quanteneinheiten miteinander verbindet, 2027. Starling soll 2029 anspruchsvolle Aufgaben in der Arzneimittelentwicklung, bei neuen Materialien oder Molekularstruktursimulationen bewältigen. Nach 2033 ist eine Blue Jay-Plattform mit bis zu 2.000 logischen Qubits und der Fähigkeit, mehr als eine Milliarde Operationen durchzuführen, geplant. Dieser schrittweise Ansatz zeigt, wie sich Quantenchips allmählich dem Einsatz in der realen Welt außerhalb des Labors nähern.

Quelle: tomshardware.com/tech-industry/quantum-computing/ibm-is-building-a-large-scale-quantum-computer-that-wrequire-the-memory-of-more-than-a-quindecillion-of-the-worlds-most-powerful-supercomputers-to-simulate

KI-Tools zeigen jetzt Werbung und gesponserte Empfehlungen

Kürzlich gab es Fälle, in denen ChatGPT und andere KI-Dienste Empfehlungen oder gesponserte Links in Antworten einfügten, wie ein Benutzerbeitrag auf Reddit bestätigt. Ein ähnlicher Ansatz wurde bereits von Tools wie Perplexity umgesetzt, wo KI Produkte oder Dienstleistungen als Teil der Suchergebnisse anbietet. OpenAI hat die Möglichkeit künftiger Werbeeinnahmen angedeutet, insbesondere aufgrund des Verhältnisses zwischen zahlenden und nicht zahlenden Nutzern, und experimentiert wie andere Plattformen mit der Monetarisierung von KI durch Werbung oder Premium-Abonnementmodelle.

Diese Veränderung spiegelt den Wunsch der Unternehmen wider, ihre Einnahmen mit einer wachsenden Gruppe von Nutzern, die immer noch Basisversionen kostenloser Dienste verwenden, zu erhalten oder zu steigern. Werbeelemente können die Form von direkt eingebetteten Chat-Empfehlungen oder Pop-ups mit relevanten Produkten annehmen. Daher müssen die Nutzer auch bei der Nutzung von KI-Chats darauf gefasst sein, dass die Antworten kommerzielle Vorschläge enthalten und Informationen unabhängig verifizieren können, ähnlich wie bei herkömmlichen Werbemodellen im Internet.

Quelle: adguard.com/de/blog/chatgpt-ads-introduce-openai-blocking.html

ToS;DR übersetzt die Bedingungen und Konditionen in eine verständliche Form

Das Projekt Terms of Service; Didn’t Read (ToS;DR) sammelt und analysiert die Allgemeinen Geschäftsbedingungen der beliebtesten Internetdienste, um problematische Passagen hervorzuheben und sie in „menschlicher Sprache“ zu erklären. Freiwillige bewerten jede Klausel nach ihrem Umgang mit den Rechten der Nutzer. Sie markieren sie mit farblich gekennzeichneten Kategorien von A (am besten) bis E (unsicher) und weisen auf Situationen hin, in denen Dienste Daten missbrauchen oder Inhalte speichern, von denen Sie glauben, sie bereits gelöscht zu haben.

Der Dienst ist seit mehr als einem Jahrzehnt verfügbar und hilft den Menschen, schnell zu erkennen, welche Bedingungen es wert sind, mit Vorsicht gelesen oder Alternativen in Betracht gezogen zu werden. Zu den Plattformen mit den schwächsten Bewertungen gehören große Plattformen wie Facebook und YouTube, die in den Allgemeinen Geschäftsbedingungen oft weitreichenden Zugriff auf Nutzerdaten erhalten. Auf den Datenschutz ausgerichtete Dienste wie Startpage oder Tor Browser erhalten bessere Bewertungen. ToS;DR macht es also einfacher, hinter die Kulissen digitaler Dienste zu blicken und hilft den Nutzern, besser informierte Entscheidungen zu treffen.

Quelle: tosdr.org/de

Google Maps unterstützt umweltfreundlichere Reisen im Sommer

Google Maps erweitert Funktionen, die mithilfe von KI empfehlen, zu Fuß zu gehen oder öffentliche Verkehrsmittel zu benutzen, wenn die Geschwindigkeit mit der eines Autos vergleichbar ist. Sie werden die Vorhersage solcher Alternativen auf neue europäische Städte ausdehnen und so zig Millionen Autofahrten vermeiden.

Für Radfahrer werden detaillierte Daten über Fahrradrouten in anderen Städten, Informationen über spezielle Fahrspuren, Verkehr und Steigungen hinzugefügt. Es werden auch Routen mit niedrigem Kraftstoff- oder Energieverbrauch und Warnungen vor Umweltzonen an mehr als tausend Orten in Europa verfügbar sein.

Quelle: blog.google/products/maps/new-maps-updates-for-sustainable-travel-europe/

Cloudflare wehrt Rekord-DDoS-Angriff ab

Cloudflare hat den bisher größten DDoS-Angriff erfolgreich abgewehrt, bei dem ein Angreifer eine Ziel-IP-Adresse mit Daten von 7,3 Tbps überflutete und 37,4 TB in 45 Sekunden verschickte, was etwa 9.350 HD-Filmen entspricht. Der Angriff nutzte massive UDP-Fluten, die auf alle Ports abzielten, sowie Reflection-Techniken (Verstärkung), bei denen gefälschte Anfragen legitime Server dazu zwangen, Antworten direkt an die Opfer zu senden und so die Last zu vervielfachen.

In den letzten Jahren haben ähnliche extreme Angriffe zugenommen: Spitzenwerte von etwa 3,47 Tbps im Jahr 2022, 5,6 Tbps im letzten Jahr und 6,5 Tbps mit einer Dauer von 49 Sekunden im April dieses Jahres. Selbst wenn fortschrittliche Systeme zur Erkennung und Abwehr von Bedrohungen eingesetzt werden, bilden solche massiven Reflexangriffe Botnets aus kompromittierten Geräten und bleiben ein relativ billiges Mittel, um die Widerstandsfähigkeit von Infrastrukturen zu erpressen oder zu testen. Die kontinuierliche Entwicklung von Abwehrmechanismen ist daher entscheidend für die Aufrechterhaltung der Verfügbarkeit von Online-Diensten.

Quelle: tomshardware.com/tech-industry/cyber-security/massive-ddos-attack-delivered-37-4tb-in-45-seconds-equivalent-to-10-000-hd-movies-to-one-victim-ip-address-cloudflare-blocks-largest-cyber-assault-ever-recorded

Microsoft entfernt veraltete Treiber aus Windows Update

Microsoft beginnt mit der schrittweisen Bereinigung alter Treiber aus Windows Update, für die es Ersatz gibt und die eine Sicherheitslücke oder ein Risiko darstellen könnten. In der ersten Phase werden Treiber entfernt, deren Gültigkeit abgelaufen ist und die nicht an ein aktuelles System-Update gebunden sind.

Der Prozess wird schrittweise eingeführt: Nach Ablauf des Supports gibt es ein 6-monatiges Zeitfenster, in dem die Partner den Treiber bei Bedarf wieder in Windows Update aufnehmen können, mit entsprechender Begründung und Genehmigung von Microsoft. Wenn es keine Einwände gibt, werden die Treiber dauerhaft entfernt. Ziel ist es, sicherzustellen, dass der Update-Service nur die optimalen und unterstützten Treibersätze für aktuelle Geräte anbietet.

Quelle: techcommunity.microsoft.com/blog/hardwaredevcenter/removal-of-unwanted-drivers-from-windows-update/4425647

Mai 2025

ChatGPT Deep Research ist jetzt ohne Abonnement verfügbar

OpenAI macht die erweiterte Deep Research-Funktion für eine größere Anzahl von ChatGPT-Nutzern verfügbar, auch für diejenigen, die kein kostenpflichtiges Abonnement haben. Diese Funktion ermöglicht es dem Chatbot, komplexe Analysen und durchdachte Antworten auf anspruchsvollere Fragen zu erstellen.

Nicht zahlende Nutzer haben in der Light-Version der Funktion 5 Aufgaben pro Monat. Die größte Anzahl von Aufgaben steht den Abonnenten der Pro-Version zur Verfügung (125 Aufgaben pro Monat plus 125 in der Light-Version), gefolgt von den Plus- und Team-Versionen (10 + 15 Aufgaben). Nutzer von ChatGPT Edu können Deep Research 10 Mal pro Monat nutzen, allerdings ohne die Light-Version. Die Funktion ist jetzt auch für slowakische Benutzer verfügbar. Achten Sie auf das Menü Deep Research in der Benutzeroberfläche.

Quelle: androidauthority.com/chatgpt-deep-research-lightweight-expansion-3548045/

ChatGPT kann Ihnen auch beim Einkaufen helfen

OpenAI hat eine neue Funktion innerhalb des GPT-4o eingeführt, die es ChatGPT ermöglicht, als Einkaufsassistent zu fungieren. Er wird den Nutzern personalisierte Produktempfehlungen mit Bildern, Preisen, Bewertungen und Links zu E-Shops in Kategorien wie Mode, Schönheit, Haushalt und Elektronik geben.

Die Funktion ist für alle Benutzer kostenlos und sogar ohne Anmeldung verfügbar. OpenAI versichert, dass die Designs keine Werbung enthalten werden und das Unternehmen nicht von der Funktion profitiert. ChatGPT erweitert damit die Nutzung von Texterstellung und Deep Research auf praktische Hilfe beim Online-Shopping. OpenAI stellt die Funktion schrittweise zur Verfügung und sollte sie bald in Ihrer Benutzeroberfläche ausprobieren können.

Quelle: gizmochina.com/2025/04/29/chatgpt-shopping-features-launched/

Google hat fast die Hälfte der Apps aus dem Play Store gelöscht, der Grund ist die Verschärfung der Qualitätsanforderungen

Google hat die Zahl der Apps im Play Store seit Anfang 2024 von mehr als 3,4 Millionen auf rund 1,8 Millionen reduziert. Das Unternehmen hat strengere Qualitätsregeln eingeführt, die kaputte, spammige oder irreführende Apps verbieten und die Überprüfung von Entwicklern, neue Kontotests und manuelle Kontrollen verstärkt.

Im Jahr 2024 hat Google nicht nur Millionen von bereits veröffentlichten Apps entfernt, sondern auch 2,36 Millionen neue Titel blockiert, bevor sie veröffentlicht wurden. Außerdem wurden mehr als 158.000 Entwicklerkonten gelöscht, die mit bösartigen Inhalten in Verbindung gebracht wurden. Trotz dieser Säuberung wurden in diesem Jahr mehr als 10.000 neue Qualitäts-Apps hinzugefügt. Das Ziel ist es, den Nutzern sichere und wertvolle Inhalte zu bieten, die frei von Spam und nutzlosen Apps sind.

Quelle: androidauthority.com/google-play-store-apps-count-may-2025-3549299/

Microsoft wird immer teurer – höhere Preise für Xbox, Spiele und Controller

Ab dem 1. Mai 2025 hat Microsoft die Preise für seine Spielkonsolen und sein Zubehör weltweit erhöht, auch in der Slowakei. Die Basisversion der Xbox Serie S kostet jetzt ab €350, während die Xbox Serie X bei €550 beginnt und das 2TB-Modell bis zu €700 kostet. Die Preise für die offiziellen Controller reichen von 65 € für das Standardmodell bis 150 € für den Xbox Elite Wireless Controller Series 2.

Zusammen mit der Hardware plant Microsoft, den Preis ausgewählter neuer Spiele bis zum Ende des Jahres von den üblichen 70 auf 80 Dollar anzuheben, was in Europa einer Erhöhung von etwa 10 bis 15 Euro entspricht. Das Unternehmen begründet diesen Schritt mit den steigenden Entwicklungskosten. Die monatlichen Gebühren für den Xbox Game Pass bleiben unverändert.

Quelle: support.xbox.com/de-US/help/hardware-network/console/may-2025-pricing-updates

Microsoft führt die kennwortlose Anmeldung für neue Benutzer ein

Microsoft deaktiviert jetzt standardmäßig Passwörter für neue Konten und bietet nur noch passwortlose Authentifizierungsmethoden wie Authenticator, Biometrie und Passkeys an. Für bestehende Benutzer können Sie Ihr Passwort in Ihren Kontoeinstellungen entfernen und zu modernen Formen der Anmeldung wechseln.

Dieser Schritt folgt den langjährigen Bemühungen, die Schwachstellen herkömmlicher Passwörter zu beseitigen und die Sicherheit der Konten zu erhöhen. Die passwortlose Anmeldung verringert das Risiko von Angriffen durch Passwortdiebstahl, Phishing oder Wiederverwendung von Passwörtern und wird zum Standard für neue Microsoft-Konten.

Quelle: microsoft.com/de-us/security/blog/2025/05/01/pushing-passkeys-forward-microsofts-latest-updates-for-simpler-safer-sign-ins/

Skype wurde beendet, was passiert mit Ihrem Konto?

Am 5. Mai 2025 hat Microsoft Skype eingestellt . Ihre Kontakte, Ihr Anrufprotokoll und Ihre Chats werden automatisch in die kostenlose Version Microsoft Teams übertragen, ohne dass Sie ein neues Konto erstellen müssen.

Die Domain web.skype.com wird zu Teams umgeleitet, wo Sie sich mit Ihrem Skype-Konto anmelden und auf Ihre vorhandenen Daten zugreifen können. Wenn Sie nicht zu Teams wechseln möchten, können Sie Ihre Skype-Daten, einschließlich archivierter Unterhaltungen, bis Januar 2026 exportieren. Nach diesem Datum werden alle Ihre Skype-Daten endgültig gelöscht. Skype for Business ist von dieser Änderung nicht betroffen.

Quelle: support.microsoft.com/de-sk/skype/skype-odch%C3%A1dza-do-d%C3%B4chodku-v-m%C3%A1ji-2025-%C4%8Do-you-need-know%C5%A5-2a7d2501-427f-485e-8be0-2068a9f90472

Chrome für Android warnt vor gefährlichen Benachrichtigungen

Google führt ein neues System zur Erkennung bösartiger Benachrichtigungen in die mobile Version von Chrome ein, das künstliche Intelligenz verwendet, um eingehende Benachrichtigungen zu scannen. Wenn Chrome eine potenziell spammige oder betrügerische Benachrichtigung identifiziert, bietet es Ihnen automatisch die Möglichkeit, sich von dieser Seite abzumelden, ohne dass Sie Ihre Einstellungen manuell durchsuchen müssen.

Die Funktion ist eine Reaktion auf den zunehmenden Missbrauch von Webbenachrichtigungen für Betrug und unerwünschte Werbung. Google nutzt sie, um die Sicherheit für Chrome-Nutzer auf Android-Geräten zu erhöhen und bereitet sie als Teil einer breiteren Suite von Schutz-Tools vor, einschließlich eines erweiterten Sicherheitsmodus für Android.

Quelle: androidauthority.com/chrome-android-web-notification-warning-3555382/

Google wechselt nach zehn Jahren zu einem neuen Logo

Google ändert sein ikonisches „G“-Logo, das zuletzt im Jahr 2015 einer größeren Umgestaltung unterzogen wurde. Die neue Version behält die ursprüngliche Form und Farbpalette bei, verwendet aber anstelle eines strikten Übergangs zwischen Rot, Gelb, Grün und Blau einen allmählichen Übergang zwischen Farben, die ineinander übergehen. Das Logo ist vom Designstil der KI-Tools von Gemini inspiriert und spiegelt den Übergang des Unternehmens zu KI-Funktionen wider.

Die Änderungen sind bisher in der Beta-Version der mobilen Google-Suche auf Android und iOS erschienen und werden nach und nach auf die stabilen Versionen anderer Google-Apps wie Maps und Chrome ausgeweitet. Obwohl es sich aus Sicht des Nutzers eher um eine subtile kosmetische Veränderung handelt, signalisiert Google mit dieser Änderung eine neue grafische Richtung und stärkt seine Position im Bereich KI.

Quelle: 9to5google.com/2025/05/12/google-icon-update/

Teams werden Screenshots in Unterhaltungen deaktivieren

Microsoft plant, der Teams-App ab Juli 2025 einen Modus „Prevent Screen Capture“ hinzuzufügen, der unbefugte Bildschirmaufnahmen in Gruppenanrufen verhindert. Die Teilnehmer sehen einen schwarzen Bildschirm, wenn sie versuchen, einen Schnappschuss zu machen, um sensible Informationen in der Videokonferenz zu schützen.

Die Funktion wird optional sein und auf Windows, Mac, Android, iOS und im Webinterface verfügbar sein. Nicht unterstützte Plattformen werden nur im Audio-Meeting-Modus arbeiten können. Diese Nachricht fügt sich in einen breiteren Trend zum Schutz von Inhalten in Apps ein – wie bei WhatsApp wird der Medienexport eingeschränkt und es wird schwieriger, unbefugte Screenshots zu machen, obwohl die Aufnahme von Fotos mit externen Geräten nicht vollständig verhindert wird.

Quelle: microsoft.com/de-us/microsoft-365/roadmap?id=490561

Copilot wird auch sprachgesteuert sein

Microsoft hat der Windows Insider-Version von Copilot die Möglichkeit hinzugefügt, den Assistenten per Sprache mit dem Befehl „Hey Copilot“ zu aktivieren . Nachdem Sie die Version 1.25051.10.0 der Anwendung installiert haben, können Sie diese Funktion über die Tastenkombination Alt + Leertaste aktivieren. Nachdem Sie die Aktivierungsphrase gesagt haben, sehen Sie eine schwebende Oberfläche mit einem Mikrofon, das Sie darüber informiert, dass Sie zuhören. Wenn es ein paar Sekunden lang keinen Ton aufnimmt, schaltet es sich automatisch aus.

Microsoft betont, dass der gesamte vorverarbeitete 10-Sekunden-Puffer der Spracheingabe auf dem Gerät verarbeitet und nicht an die Cloud gesendet wird. Erst dann werden die Audiodaten an die Cloud gesendet, wo eine eingehende Analyse der Befehle stattfindet. Dadurch wird die Menge der übertragenen sensiblen Informationen reduziert und die Privatsphäre des Benutzers gewahrt.

Quelle: blogs.windows.com/windows-insider/2025/05/14/copilot-auf-windows-hey-copilot-beginnt-auszurollen-zu-windows-insiders/

YouTube-Anzeigen werden bald noch lästiger sein

YouTube plant eine neue Art der Anzeigenschaltung, bei der die künstliche Intelligenz von Google, Google Gemini , nach dem attraktivsten oder ansprechendsten Moment in einem Video sucht und dort einen Werbespot einfügt. Damit soll die Aufmerksamkeit auf die Werbung gelenkt werden, auch wenn dies insbesondere bei Nutzern ohne Abonnement zu weiteren Störungen führen kann.

Es ist noch nicht klar, ob diese Anzeigen übersprungen werden können und wie sie genau dargestellt werden. Es wird jedoch erwartet, dass die neue Anzeigenplatzierung die Motivation der Nutzer erhöht, zu YouTube Premium zu wechseln, wo überhaupt keine Werbung angezeigt wird. Der Preis für Premium reicht von 4,99 € für einen Studententarif bis 15,99 € für einen Familientarif.

Quelle: androidauthority.com/youtube-peak-points-ads-3557905/

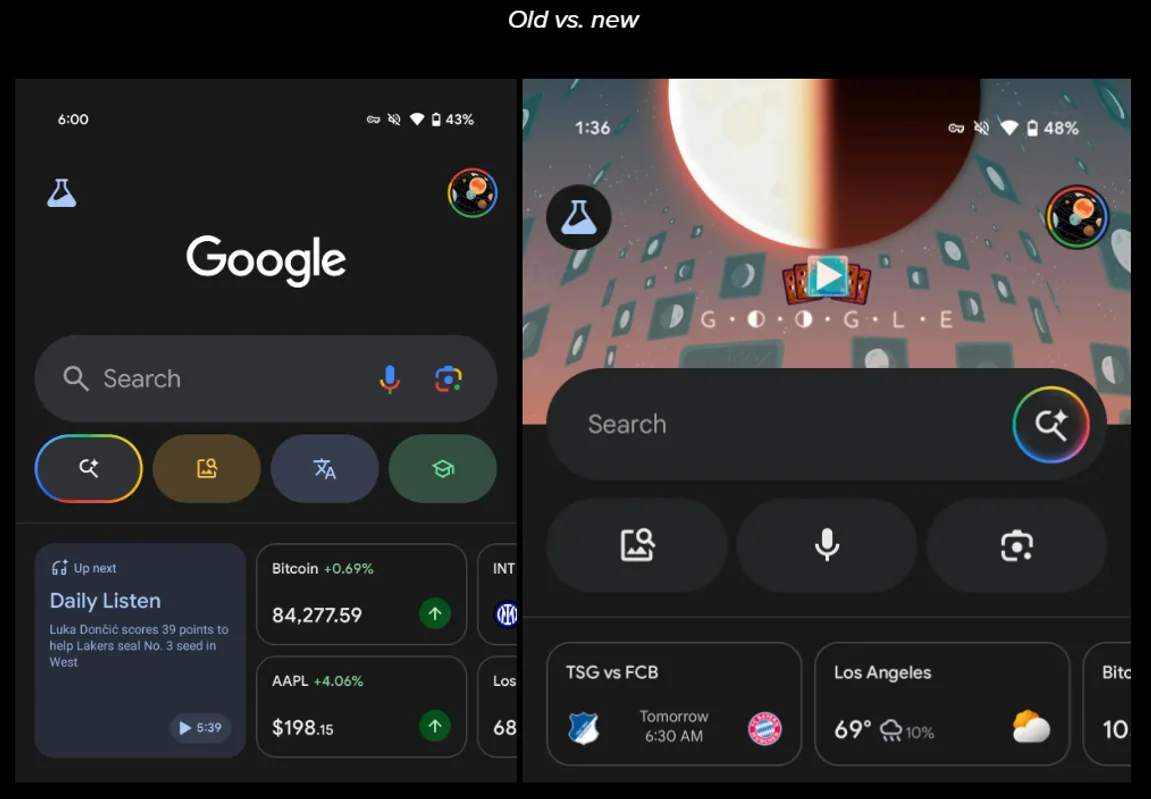

Google bringt einen neuen KI-Modus für die Suche

Google hat in seinen mobilen Apps für Android und iOS eine Verknüpfung für den KI-Modus eingeführt, die die bestehenden Symbole für die Sprachsuche und Google Lens ersetzt. Die neue Schaltfläche oben in der Suchleiste trägt das Sternsymbol des Gemini Assistant und die Farbverläufe des frisch enthüllten Logos.

Die Funktion ermöglicht es, den KI-Assistenten direkt und schnell von der Suche aus zu starten, ohne dass Sie in andere Modi wechseln müssen. Mit der Einführung des KI-Modus hat Google auch die Sprachsuche und die Linse in der Benutzeroberfläche eine Ebene nach unten verschoben, um die obere Leiste zu vereinfachen. Der KI-Modus bietet Nutzern Zugang zu fortschrittlichen generativen Intelligenzfunktionen direkt in ihrer normalen Suche nach Informationen. Die neue Funktion wird derzeit schrittweise in die stabilen Versionen der App eingeführt, während Google auch einen Widget-basierten Aufruf des KI-Modus auf dem Startbildschirm testet.

Quelle: 9to5google.com/2025/05/16/google-ai-mode-search-bar-android-ios/

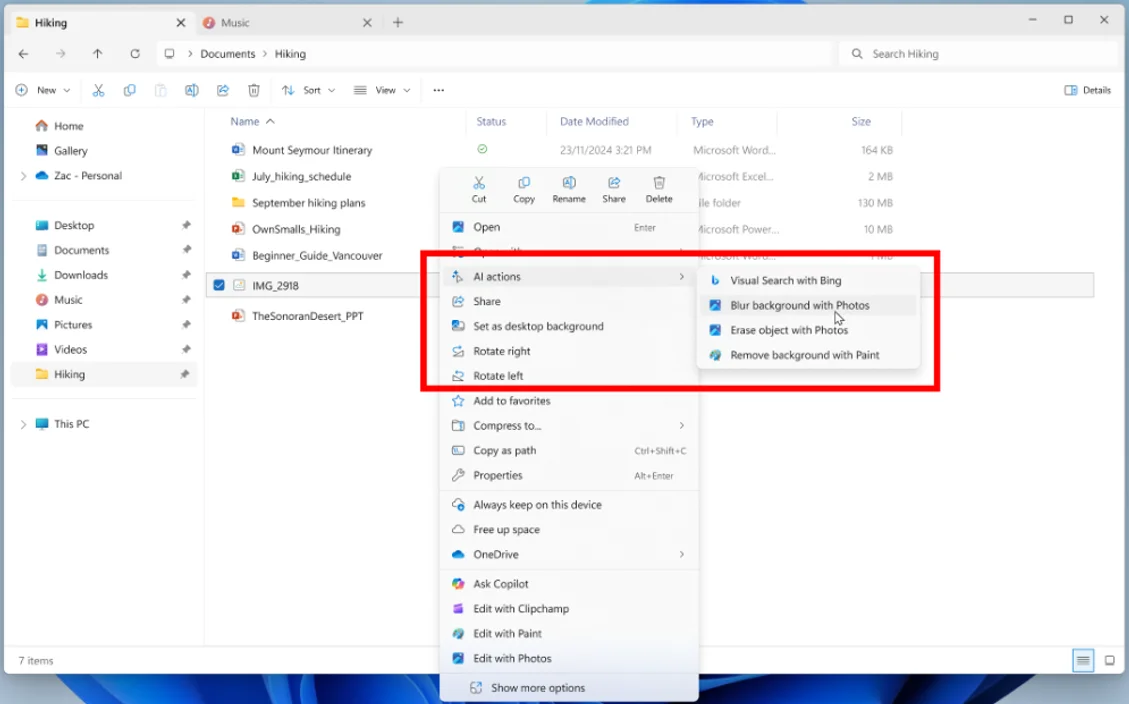

Windows Explorer erhält KI-Aktionen für die schnelle Bildbearbeitung

In der Entwicklerversion von Windows 11 wurde dem Explorer ein neues Untermenü KI-Aktionen hinzugefügt, das vier Werkzeuge für die Bearbeitung von Bildern direkt über das Kontextmenü bietet. Die erste Option löst eine visuelle Suche über Bing aus, die zweite verwischt mit einem Klick den Hintergrund, die dritte entfernt unerwünschte Objekte und die vierte schneidet das Objekt aus dem Hintergrund aus.

Diese Aktionen nutzen die integrierten Anwendungen Paint und Fotos, so dass das Bild nach der Auswahl in der jeweiligen Anwendung geöffnet wird, um es abschließend zu bearbeiten. Unterstützt werden die Formate .jpg, .jpeg und .png, die eine schnelle grundlegende Bearbeitung ermöglichen, ohne dass Sie externe Grafikprogramme verwenden müssen.

Quelle: blogs.windows.com/windows-insider/2025/05/19/announcing-windows-11-insider-preview-build-26200-5603-dev-channel/

Google AI wird mehr Funktionen kostenlos zur Verfügung stellen

Auf der Konferenz I/O 2025 kündigte Google an, dass viele KI-Funktionen ohne ein kostenpflichtiges Abonnement verfügbar sein werden. Die Gemini Live App wird in den Android- und iOS-Versionen um kostenlose Tools für die Erkennung von Inhalten auf dem Bildschirm oder in Echtzeit mithilfe der Kamera erweitert, ohne dass ein Abonnement erforderlich ist.

Gleichzeitig hat Google neue kostenpflichtige Pakete innerhalb von Google One eingeführt – Google AI Pro (€21,99 pro Monat) und Google AI Ultra ($249,99 pro Monat, zunächst in den USA). Das Pro-Paket umfasst 2 TB Speicherplatz, Zugang zu Gemini Pro und NotebookLM Pro sowie die Verknüpfung von KI mit persönlichen Dokumenten oder E-Mails. Ultra bietet zusätzlich die Videoerstellung über Veo 3 und die bevorzugte Nutzung von Deep Think 2.5 Pro.

Zu den weiteren neuen Funktionen gehören das Imagen 4-Modell für die Bilderzeugung und ein interaktiver Canvas-Modus, mit dem Codebearbeitung, Infografiken, Quizfragen oder Audiozusammenfassungen direkt im KI-Tool erstellt werden können, was die Arbeit von Programmierern und Content-Erstellern erleichtert.

Quelle: blog.google/products/gemini/gemini-app-updates-io-2025/

Google Veo 2 erweitert die KI-Videofunktionen

Veo 2, Googles KI-gestütztes Tool zur Erstellung von Kurzvideos, hat neue Funktionen für eine detailliertere Inspektion von Szenen erhalten. Benutzer können Charaktere und Objekte definieren, einen einheitlichen Stil wählen, auch wenn sie Cartoon-Elemente mit Fotos kombinieren, und das Seitenverhältnis des Videos anpassen, um z. B. ein Porträt auf eine liegende Position zu erweitern.

Außerdem wurden Kamerasteuerungen mit Bewegungs- und Winkeleinstellungen sowie die Möglichkeit hinzugefügt, Objekte aus einer bestehenden Komposition hinzuzufügen oder zu entfernen. Diese Erweiterungen stehen allen Abonnenten des AI-Pakets (Ultra in den USA) zur Verfügung und die Beschränkungen für die Anzahl der pro Monat erstellten Videos bleiben unverändert.

Quelle: blog.google/technology/ai/generative-media-models-io-2025

April 2025

Sony verbessert Fotoqualität – Vorbereitung eines 200-Megapixel-Sensors

Sony bereitet einen neuen 200-Megapixel-Bildsensor vor, der eine höhere Auflösung als bisherige Lösungen bieten wird – mit besserer Low-Light-Leistung, detaillierteren Bildern und verbessertem Zoom. Der Sensor wird nicht nur für eigene Modelle, sondern auch für andere Smartphone-Hersteller verfügbar sein. Mit diesem Fokus auf Bildqualität will Sony mit Samsung konkurrieren, das im Bereich hoher Auflösungen dominiert. Bei einer Sensorgröße von 1/1,3 Zoll und fortschrittlichen Technologien wird erwartet, dass der Sensor Autofokus, Nachtsicht und Rauschunterdrückung verbessert. Die ersten Flaggschiffmodelle mit diesem Sensor könnten Ende 2025 erscheinen.

Quelle: notebookcheck.net/Sony-s-new-200-MP-sensor-to-crush-the-opposition-and-be-adopted-by-next-gen-flagships.985233.0.html

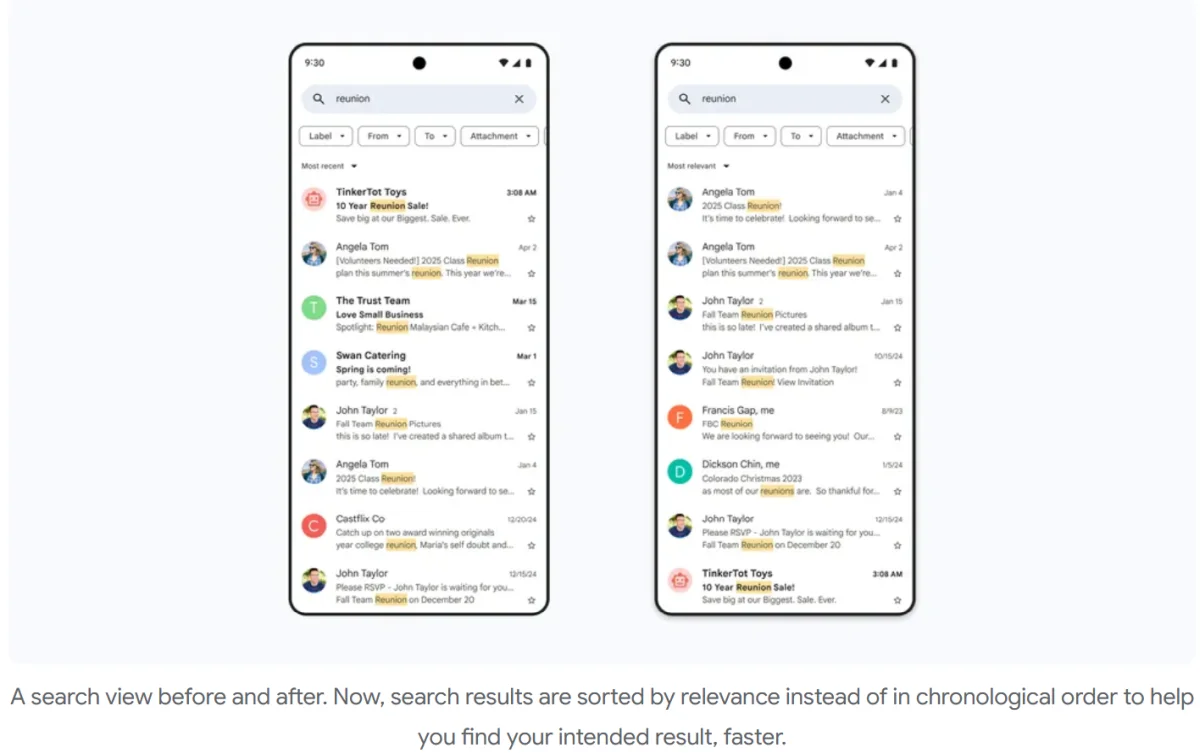

Gmail verbessert E-Mail-Suche mit KI

Gmail nutzt jetzt KI, um Suchergebnisse zu optimieren. Nutzer können zwischen relevantesten und neuesten E-Mails wechseln, sodass gewünschte Nachrichten häufiger oben erscheinen. Die Funktion ist in der Webversion sowie in Android- und iOS-Apps verfügbar. Die KI bewertet Relevanz anhand von Faktoren wie Aktualität, häufig angeklickte Nachrichten oder regelmäßige Kontakte. Die Einführung erfolgt schrittweise für alle Nutzer; Firmenkonten folgen später.

Quelle: blog.google/products/gmail/gmail-search-update-relevant-emails/

Gemini AI erleichtert die Programmierung mit der neuen Canvas-Funktion

Google hat die Canvas-Funktion in Gemini eingeführt, die eine einfachere Bearbeitung von Code und Text ermöglicht. Canvas bietet eine übersichtliche Oberfläche mit einer Frage- und Antwortaufteilung, und der resultierende Code kann einfach kopiert und bearbeitet werden. Die Funktion ist für Gemini und Gemini Advanced verfügbar und funktioniert mit dem 2.0 Flash-Modell. Sie ermöglicht dir, bestimmte Textabschnitte zu markieren, um den Ton, die Länge oder das Format anzupassen. Programmierer werden die Möglichkeit zu schätzen wissen, HTML- und React-Codes in der interaktiven Vorschau zu testen. Die erstellten Dokumente können in Google Docs exportiert werden.

Quelle: blog.google/products/gemini/gemini-collaboration-features/

ChatGPT verbesserte Bilderzeugung im Modell GPT-4o

OpenAI hat die Möglichkeit verbessert, Bilder direkt in ChatGPT zu erzeugen, einschließlich der Unterstützung für die Bearbeitung von Bildern direkt in der Chat-Oberfläche. Die Funktion verwendet das GPT-4o-Modell, das Aufgaben besser versteht und mit mehreren Objekten gleichzeitig arbeiten kann. Du kannst Bilder erzeugen, ohne dich anzumelden, erhältst aber mehr Optionen, wenn du angemeldet bist. Die Bilder enthalten C2PA-Informationen, die den Ursprung und die Bearbeitungshistorie aufzeichnen. Die Funktion ist zwar noch nicht perfekt, insbesondere bei komplizierten Postern oder Texten, aber sie erweitert die Möglichkeiten der Grafikerstellung in ChatGPT erheblich.

Quelle: openai.com/index/introducing-4o-image-generation/

Windows 11 und Copilot – Microsoft stellt eine Roadmap mit neuen Funktionen vor

Microsoft hat eine klare Roadmap der kommenden Funktionen für Windows 11 und den Copilot-Assistenten veröffentlicht, um einen transparenten Überblick über die Entwicklung des Systems zu geben und IT-Profis auf die kommenden Änderungen vorzubereiten. Zu den geplanten neuen Funktionen gehören Features wie die automatische Aktualisierung von Registerkarten im Explorer, Web-Widgets für Entwickler und eine verbesserte Berechnung der CPU-Auslastung im Task Manager. Jede Funktion in der Tabelle ist nach ihrem Fertigstellungs- und Verfügbarkeitsstatus gekennzeichnet – zum Beispiel nur für das Insider-Programm oder in der breiteren Rollout-Phase. Zu den bereits verfügbaren Funktionen gehört zum Beispiel Cocreator im Copilot+ Device Sketchpad.

Quelle: microsoft.com/de-us/windows/business/roadmap

Gorilla Glass Ceramic – die nächste Generation des Displayschutzes

Corning hat eine neue Displayschutztechnologie eingeführt – Gorilla Glass Ceramic, die keramische Materialien verwendet, um die Haltbarkeit zu erhöhen, und die den Ehrgeiz hat, bestehende Varianten wie Victus oder Victus 2 zu ersetzen. Das neue Gorilla Glass Ceramic hat einen erhöhten Anteil an Keramik und kann wiederholten Stürzen aus einem Meter Höhe auf eine harte, asphaltähnliche Oberfläche standhalten. Dies ist eine Reaktion auf die häufigen Schäden an Displays, die einer der häufigsten Gründe für den Austausch von Telefonen sind. Das erste Gerät mit dieser Technologie wird voraussichtlich von Motorola kommen, und es wird erwartet, dass Keramiklösungen in den hochwertigsten Modellen zum Standard werden.

Quelle: androidauthority.com/corning-gorilla-glass-ceramic-3539449/

Bill Gates über KI: Drei Berufe, die ihre Jobs (noch) nicht verlieren werden

Bill Gates sagt voraus, dass künstliche Intelligenz den Arbeitsmarkt im nächsten Jahrzehnt dramatisch verändern wird, aber einige Berufe bleiben vorerst sicher. Dazu gehören Entwickler, Energietechniker und Biologen.

Gates weist darauf hin, dass KI zwar viele Aufgaben ersetzen wird, aber weiterhin Menschen braucht, die kreativ sind, komplexe Probleme lösen und die Entwicklung überwachen. Programmierer sind wichtig, um Code zu erstellen und zu debuggen, Energieingenieure arbeiten mit hochkomplexen Systemen, und in der Biologie ist weiterhin menschlicher Erfindungsreichtum für Forschung und Entdeckung gefragt.

Quelle: windowscentral.com/software-apps/bill-gates-says-ai-will-replace-humans-for-most-things

Microsoft Office wird den Start beschleunigen – zuerst in Word

Ab Mai wird Word dank des Task-Schedulers, der die Anwendung beim Start initialisiert, schneller starten. Eine neue Funktion namens „Office Startup Boost“ ermöglicht es Word, schneller zu laden, indem es seine Initialisierungskomponenten startet, sobald der Computer eingeschaltet wird. Die Funktion wird nur auf Geräten mit mindestens 8 GB RAM und 5 GB freiem Speicherplatz aktiviert. Sie ist optional und wird nicht ausgeführt, wenn der Energiesparmodus aktiviert ist. Obwohl die Funktion eher für Excel geeignet wäre, testet Microsoft sie zunächst in Word.

Quelle: zdnet.com/article/ihre-microsoft-office-apps-wird-soon-launch-schneller-aber-der-geschwindigkeitsboost-ist-optional/

Google Maps verstärkt den Kampf gegen gefälschte Bewertungen

Google verbessert seine Systeme zur Erkennung gefälschter Bewertungen mit Hilfe von künstlicher Intelligenz und der Gemini-Technologie und führt die Maßnahmen weltweit ein. Google Maps versucht schon seit langem, den Missbrauch von Bewertungen (z. B. den Kauf von Fünf-Sterne-Bewertungen, ohne Besuch der Einrichtung) und die Bearbeitung von Einrichtungsprofilen einzudämmen. Im Jahr 2024 hat das Unternehmen bereits mehr als 240 Millionen gefälschte Bewertungen und 12 Millionen gefälschte Profile entfernt, von denen die meisten von Algorithmen erkannt wurden, bevor sie veröffentlicht wurden. Das neue, auf Gemini basierende KI-Modell kann betrügerisches Verhalten anhand mehrerer neuer Missbrauchsmuster erkennen und dabei helfen, Tausende von verdächtigen Bearbeitungen von Unternehmensprofilen zu blockieren und die Glaubwürdigkeit von Bewertungen zu erhöhen.

Die neuen Sicherheitsmaßnahmen sind bereits in den USA, Großbritannien und Indien in Kraft, werden aber ab nächsten Monat weltweit eingeführt. Die Nutzer werden auf gelöschte Bewertungen und verdächtige Profile aufmerksam gemacht. Mit diesen Maßnahmen will Google sicherstellen, dass Maps ein vertrauenswürdiges Tool für Millionen von Nutzern auf der ganzen Welt bleibt.

Quelle: 9to5google.com/2025/04/07/google-maps-fake-reviews/

Microsoft feiert 50 Jahre – spezielle Hintergrundbilder, Themen und Bonusinhalte

Zur Feier des 50. Jahrestages seiner Gründung hat Microsoft eine limitierte Auflage von grafischen Themen und Retro-Elementen für Windows- und Xbox-Nutzer vorbereitet.

Microsoft wurde am 4. April 1975 gegründet und feiert heute sein fünfzigjähriges Jubiläum. Auf einer speziellen Unlocked-Seite hat das Unternehmen einen Rückblick auf seine Geschichte veröffentlicht und bietet Fans die Möglichkeit, spezielle Jubiläums-Hintergründe für Windows und Xbox herunterzuladen, die ikonischen Spielen und Apps wie Solitaire und Sketchpad Tribut zollen. Zusätzlich zu den Hintergründen kann auch die Rückseite der Karten in der Microsoft Solitaire Collection im Microsoft Store geändert werden.

Der Microsoft Edge-Browser hat ein spezielles nostalgisches Jubiläumsthema erhalten, das exklusiv für den Browser verfügbar ist. Außerdem hat der Clipchamp Video-Editor Jubiläumselemente wie Retro-Symbole, nostalgische Fenster und hochauflösende Grafiken hinzugefügt, die du in deine Videos einbetten kannst. So bietet Microsoft modernen Nutzern die Möglichkeit, mit einem modernen Design in Erinnerungen an die alten Zeiten zu schwelgen.

Quelle: unlocked.microsoft.com/50th/

Google zieht um zu einer einzigen Google.com-Domain

Google vereinheitlicht die Suche unter einer einzigen Domain – google.com– und beendet damit die Ära der nationalen Domains wie google.sk oder google.fr. Die Änderung ist hauptsächlich technischer Natur und hat keine Auswirkungen auf die Position der Suchergebnisse.

Ab April 2025 wird Google alle seine nationalen Suchmaschinen weltweit auf google.com umleiten. Obwohl du keine Domain wie google.sk mehr sehen wirst, werden die Ergebnisse weiterhin auf deinen Standort zugeschnitten sein. Das liegt daran, dass Google seit 2017 den physischen Standort deines Geräts und nicht die Domain verwendet, um deinen Standort zu bestimmen. Für dich als Nutzer ist die Änderung also rein kosmetisch – der einzige Unterschied besteht darin, dass nur google.com im Browser angezeigt wird. In einigen Fällen musst du möglicherweise deine Sprache oder Region neu einstellen.

Mit diesem Schritt vereinfacht Google die Verwaltung seines globalen Dienstes, reduziert die technische Komplexität und reagiert besser auf eine Ära, in der mobile Geräte und KI Nutzer viel genauer lokalisieren als URL-Domains.

Quelle: 9to5google.com/2025/04/15/google-com-search/

Snipping Tool zum Ausschneiden in Windows erhält Texterkennung (OCR)

Windows 11 erhält eine praktische Erweiterung – Texterkennung (OCR) direkt im Snipping Tool. Mit dieser Funktion kannst du Text aus Bildern extrahieren, ohne externe Tools verwenden zu müssen. Microsoft fügt dem Tool eine neue Schaltfläche zur Textextraktion hinzu, die den OCR-Modus verfügbar macht. Du kannst einen bestimmten Text mit dem Cursor auswählen oder den gesamten Bereich markieren, und die Anwendung erkennt und kopiert den Text automatisch. Es wird auch Optionen zum Entfernen von Zeilenumbrüchen geben, was die anschließende Bearbeitung z. B. in Notepad oder Word erleichtert.

Die neue Funktion ist vorerst nur für Insider in Version 11.2503.27.0 verfügbar. Du öffnest das Tool wie immer über die Tastenkombination Win + Umschalt + S. Im OCR-Modus kannst du Text schnell extrahieren, ohne das Bild auf der Festplatte speichern zu müssen.

Quelle: blogs.windows.com/windows-insider/2025/04/15/text-extractor-in-snipping-tool-begins-rolling-out-to-windows-insiders/

Meta AI ist offiziell in der Slowakei und der Tschechischen Republik angekommen

Meta hat seine Meta AI endlich auch für Nutzer in der Slowakei und der Tschechischen Republik eingeführt und erweitert damit die Verfügbarkeit des Tools in ganz Europa.

Du kannst Meta AI über Meta.ai ausprobieren. Möglicherweise musst du dich über Facebook oder Instagram anmelden, um darauf zuzugreifen. Das Tool bietet Funktionen wie die Erstellung von Bildern, die Beantwortung von Fragen oder die Unterstützung bei verschiedenen Aufgaben und ist damit ein Konkurrent zu bekannten Lösungen wie ChatGPT, Copilot oder Gemini. Obwohl der Dienst vorerst nur in einem begrenzten Modus verfügbar ist, ist er der nächste Schritt in der Entwicklung von KI-Tools, die für normale Nutzer verfügbar sind.

Quelle: meta.ai/

YouTube feiert 20 Jahre – das erste Video ist immer noch online

Am 23.4.2025 ist es genau 20 Jahre her, dass das erste Video auf YouTube hochgeladen wurde. Die Plattform, die die Art und Weise, wie wir Inhalte online konsumieren, grundlegend verändert hat, feiert diesen Meilenstein mit besonderen Features und einer Rückkehr zu ihren Wurzeln.

Das erste YouTube-Video war Me at the zoo, hochgeladen vom Mitbegründer Jawed Karim am 23. April 2005. Das Video ist nur 18 Sekunden lang und zeigt ihn im San Diego Zoo, wo er über Elefanten spricht. Obwohl YouTube heute Videos im 4K-, 8K- oder VR-Format anbietet, bleibt dieses 240p-Video aus der Zeit vor der Sintflut ein Symbol für die Anfänge der Plattform. Im Jahr 2025 hat es bereits mehr als 355 Millionen Aufrufe und 17 Millionen Likes. Anlässlich des Jubiläums hat YouTube eine digitale Torte und einen Elefanten als Hommage an seine Geschichte hinzugefügt.

Heute hat YouTube 2,7 Milliarden aktive Nutzer, die sich mindestens einmal pro Woche Videos ansehen. Darüber hinaus gibt es Dutzende Millionen von Videoerstellern, die YouTube regelmäßig mit Inhalten versorgen. Mehr als drei Millionen Kanäle haben sich für das Partnerprogramm angemeldet, und Google teilt mit ihnen die Werbeeinnahmen und Premium-Abonnements. Allein in den letzten drei Jahren hat es ihnen über 70 Milliarden Dollar ausgezahlt.

Quelle: androidauthority.com/youtube-first-video-upload-20th-anniversary-3547053/

März 2025

Firefox verlängert Unterstützung für Windows 7 bis 2025

Mozilla hat beschlossen, die Unterstützung für das ältere Betriebssystem Windows 7 durch eine spezielle Version von Firefox – ESR 115 – zu verlängern. Diese Version mit erweitertem Support wird mindestens bis zum 16. September 2025 Sicherheitsupdates erhalten. Im August dieses Jahres wird eine Entscheidung über eine mögliche weitere Verlängerung getroffen. Dies ist eine gute Nachricht für Windows 7-Nutzer, da die meisten Browser die Unterstützung für dieses System bereits eingestellt haben. Die ESR-Version von Firefox ermöglicht dir, den Browser weiterhin sicher zu nutzen, allerdings ohne die neuesten Funktionsupdates. Dieses Modell ist vor allem für Unternehmen und diejenigen von Vorteil, die Stabilität häufigen Softwareänderungen vorziehen.

Quelle: whattrainisitnow.com/release/?version=esr

FreeTube bringt werbefreies und privates YouTube

Die FreeTube-App bietet dir eine Möglichkeit, YouTube-Videos ohne Werbung und ohne Anmeldung zu sehen. Sie funktioniert auf einer Vielzahl von Plattformen, einschließlich ARM-Geräten, und bietet eine portable Version, die du direkt von einem Flash-Laufwerk starten kannst. Die Benutzeroberfläche erinnert an YouTube, ist aber minimalistisch und frei von Ablenkungen. Du kannst Videos direkt abspielen oder sie herunterladen und offline ansehen. Mit FreeTube kannst du Wiedergabelisten erstellen und Kanäle ansehen, ohne dich mit einem Google-Konto zu verbinden, was deine Privatsphäre erhöht.

Quelle: github.com/FreeTubeApp/FreeTube

Google Gemini ermöglicht kostenlose Analyse von (auch gescannten) Dokumenten

Mit Google Gemini kannst du jetzt eine Vielzahl von Dokumenten analysieren, ohne dafür bezahlen zu müssen. Nutzer können Bilder, PDF- und Word-Dokumente direkt über die Weboberfläche oder die mobile App hochladen. Bezahlte Konten bieten jedoch noch weitere Optionen – wie die Unterstützung von Excel-Tabellen oder ein größeres Kontextfenster.

Das Gemini 2.0 Flash-Modell ist auch für die Programmierung geeignet, aber die Genauigkeit der Antworten hängt von einer klar definierten Aufgabe ab. In diesem Zusammenhang wird oft das KI-Tool Grok von Network X erwähnt, das je nach Genauigkeit der Anforderungen unterschiedliche Ergebnisse liefert.

Quelle: x.com/GeminiApp/status/1892678157406281931

Antropic veröffentlicht Claude 3.7 – die intelligenteste frei verfügbare KI

Die neue Version Claude 3.7 Sonnet ist deutlich leistungsfähiger als der Vorgänger 3.5 und bietet Nutzern der kostenlosen Version erweiterte Argumentationsfähigkeiten und schnellere Antworten. Abonnenten können die Genauigkeit und Länge der Antworten auf bis zu 128.000 Token einstellen.

In Benchmarks übertrifft dieses Modell Wettbewerber wie DeepSeek und OpenAI o1 um mehr als 12%. Anthropic entwickelt auch ein Claude Code Modell zur Analyse und Codegenerierung, das derzeit nur in einer Testversion verfügbar und nicht kostenlos ist.

Quelle: anthropic.com/news/claude-3-7-sonnet

Microsoft testet Werbung in Office-Anwendungen

Microsoft experimentiert mit Werbung in der kostenlosen Version seiner Office-Suite Microsoft 365 Copilot. Die Anzeigen erscheinen auf der rechten Seite der Anwendungen Word, Excel und PowerPoint und können nicht entfernt werden, es sei denn, der Nutzer abonniert die kostenpflichtige Version.

Bisher handelt es sich nur um eine Testversion, und in den Anzeigen werden hauptsächlich Microsoft-Produkte wie Designer beworben. Dokumente können in dieser Office-Version nur auf OneDrive gespeichert werden, und kostenlose Nutzer haben 5 GB Speicherplatz zur Verfügung. Trotz der Werbung und der Einschränkungen können Nutzer auch nach Ablauf des Testzeitraums Dokumente bearbeiten, was vorher nicht möglich war.

Quelle: beebom.com/microsoft-free-ad-supported-office-quietly-launched/

Copilot bietet kostenlose KI-Konversation auf dem Handy

Microsoft Copilot ist das neueste Produkt, das kostenlosen Zugang zu Sprachinteraktion und „Think Deeper„-Funktionen bietet, die bisher nur zahlenden Nutzern zur Verfügung standen. Als Nutzer kannst du ein natürliches Gespräch mit der KI führen, ohne sie erneut aktivieren zu müssen. Diese Funktionalität ist bereits von ChatGPT bekannt, aber im Falle von Copilot musst du nur die App herunterladen und kannst die KI nutzen, um nach Informationen zu suchen oder Sprachen zu lernen.

Der Mitbewerber Perplexity bietet eine ähnliche „Deep Research“-Funktion für tiefgreifende Analysen. Die kostenpflichtige Version von Copilot Pro bietet immer noch Vorteile wie höhere Abfragelimits oder Bilderzeugung, aber viele Funktionen, die bis vor kurzem noch kostenpflichtig waren, sind jetzt kostenlos verfügbar.

Quelle: microsoft.com/de-us/microsoft-copilot/blog/2025/02/25/announcing-free-unlimited-access-to-think-deeper-and-voice/

Microsoft stellt Majorana 1 Quantenchip vor

Microsoft hat seinen ersten Quantenchip mit der Bezeichnung Majorana 1 vorgestellt, der einen wichtigen Schritt in Richtung Quantencomputer darstellt. Dieser Chip ist so konzipiert, dass er auf bis zu einer Million Qubits skaliert werden kann, was den Bereich des Computings in Zukunft erheblich verändern könnte. Quantencomputer können Berechnungen viel schneller durchführen als herkömmliche Computer und könnten einen Durchbruch bei der Modellierung chemischer Reaktionen, der Entwicklung neuer Materialien oder ökologischer Lösungen bringen.

Obwohl voll funktionsfähige Quantencomputer noch Zukunftsmusik sind, konzentriert sich die Entwicklung von Microsoft auf die Stabilität von Qubits unter Verwendung eines sogenannten Topoleiters, einem speziellen Material, das es ermöglicht, den topologischen Zustand der Materie zu erzeugen. Dadurch soll das Quantencomputing stabiler und leistungsfähiger werden. Quantencomputer könnten in Zukunft in einer Vielzahl von Bereichen Anwendung finden, darunter im Gesundheitswesen, in der Landwirtschaft und in der Ökologie. Sie könnten zum Beispiel bei der Entwicklung von Katalysatern für die Zersetzung von Plastikmüll oder bei der Herstellung von regenerativen Materialien helfen.

Quelle: news.microsoft.com/source/features/innovation/microsofts-majorana-1-chip-carves-new-path-for-quantum-computing/

Microsoft plant das Ende von Skype nach mehr als 21 Jahren

Laut der neuesten Beta-Version von Skype für Windows plant Microsoft, den beliebten Kommunikationsdienst im Mai dieses Jahres einzustellen. Dir wird empfohlen, auf die kostenlose Version von Microsoft Teams umzusteigen, die nach und nach die Funktionen von Skype übernommen hat.

Skype ist seit vielen Jahren das wichtigste Tool für Videoanrufe über das Internet, aber in den letzten Jahren wurde es von modernen Anwendungen wie WhatsApp, Zoom und Microsoft Teams überschattet. Trotz der ständigen Verbesserungen, die Microsoft an Skype vornimmt, ist seine Zukunft seit der Einführung von Teams im Jahr 2017 ungewiss. Obwohl das Unternehmen das Ende von Skype noch nicht offiziell angekündigt hat, deuten Informationen aus dem Quellcode darauf hin, dass das Ende nahe ist.

Quelle: microsoft.com/de-us/microsoft-365/blog/2025/02/28/the-next-chapter-moving-from-skype-to-microsoft-teams/

Neuronales KI-Rendering kommt in DirectX

Microsoft erweitert DirectX um die Cooperative-Vectors-Technologie, um die Integration von KI direkt in die Grafikpipeline zu ermöglichen. Diese Technologie wird von GPUs von Nvidia, AMD, Intel und Qualcomm unterstützt und ermöglicht plattformübergreifendes neuronales Rendering.

Die Nachricht steht in engem Zusammenhang mit den sogenannten Neural Shaders, einer Funktion der nächsten Generation der Nvidia-Blackwell-GPUs. Sie ermöglicht es, traditionelle Shader-Berechnungen mit KI-Inferenz auf Tensor-Kernen zu kombinieren, ohne dass der Grafikprozessor in einen speziellen Modus geschaltet werden muss. Entwickler können KI-Modelle verwenden, um Materialien, Beleuchtung oder physikalische Effekte in Spielen realistischer zu simulieren. Die Unterstützung von Cooperative Vectors wird bereits im April 2025 im DirectX SDK erscheinen, aber wir werden noch länger warten müssen, bis sie tatsächlich in Spielen eingesetzt wird.

Quelle: devblogs.microsoft.com/directx/enabling-neural-rendering-in-directx-cooperative-vector-support-coming-soon/

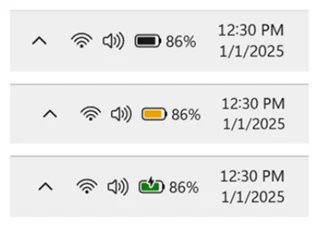

Windows 11 erhält eine neue Batterieanzeige mit farbigen Status- und Prozentangaben

Microsoft überarbeitet die Batterieanzeige in Windows 11, um sie übersichtlicher und praktischer zu gestalten. Die neue Version fügt eine farbliche Unterscheidung für den Batteriestatus hinzu und ermöglicht, Prozentwerte direkt neben dem Symbol anzuzeigen. Der Akku wird vier Farbmodi haben: grün (Laden und guter Zustand), gelb/orange (Energiesparmodus bei ≤20%), rot (kritisch niedriger Akkustand) und standardmäßig weiß (normaler Zustand). Die Anzeige des Akkuprozentsatzes ist optional und kann in den Einstellungen aktiviert werden. Die Änderung ist vorerst nur für die Insider-Version von Windows 11 verfügbar, wird aber wahrscheinlich in einem zukünftigen Update auf die stabile Version übertragen.

Quelle: blogs.windows.com/windows-insider/2025/02/28/announcing-windows-11-insider-preview-build-27802-canary-channel/

Google stellt das neue Gemma 3 vor

Gemma 3 ist das neueste multimodale KI-Modell von Google, das Text-, Bild- und Videoanalysen durchführt. Es verfügt über verbesserte mathematische Fähigkeiten, strukturierte Antworten und unterstützt über 140 Sprachen.

Die Ausführung auf einem PC ist über Ollama.com möglich, wo Versionen (1B, 4B, 12B, 27B) je nach Leistung des Geräts verfügbar sind. Die leistungsstärkste Variante bietet ein Kontextfenster von 128.000 Token. Es werden auch Community-Versionen entwickelt, die für bestimmte Aufgaben, wie Programmierhilfe, optimiert sind.

Quelle: developers.googleblog.com/de/introducing-gemma3/

Der Roboter Atlas von Boston Dynamics ahmt menschliche Bewegungen nach

Das neueste Video zeigt, dass der humanoide Roboter Atlas bereits den menschlichen Gang und andere Bewegungen nachahmen kann. Boston Dynamics nutzte die Bewegungsverfolgung echter Menschen, um dem Roboter zu helfen, natürliche Bewegungen zu erlernen, die anspruchsvoller sind als akrobatische Kunststücke. Atlas ist vorerst ein Prototyp, aber die Technologie wird ständig verbessert und bewegt sich auf eine kommerzielle Version zu. Doch die Konkurrenz wächst – mehrere Startups arbeiten an zweibeinigen Robotern für Lagerhäuser und Wohnungen, und Nvidia hat den Jetson Thor entwickelt, einen speziellen Computer zur Steuerung dieser Roboter.

Quelle: Boston Dynamics

Februar 2025

Vivaldi 7.1 – ein Browser mit besserer Personalisierung und Privatsphäre

Vivaldi, der Browser, der für seinen Fokus auf Datenschutz und Anpassbarkeit bekannt ist, hat Version 7.1 veröffentlicht, die neue Funktionen und Verbesserungen bringt. Zu den Highlights gehören ein in die Browseroberfläche integriertes Wetter-Widget, bessere Personalisierungsoptionen für das Dashboard und ein vereinfachtes Hinzufügen von Seiten zum Schnellmenü. Außerdem kannst du mit der Funktion „Registerkarte an Gerät senden“ Registerkarten schnell zwischen verschiedenen Geräten austauschen. Um die Unabhängigkeit zu wahren, hat Vivaldi einige der Standard-Suchmaschinen geändert: Startpage, Ecosia, DuckDuckGo und Qwant gehören jetzt zu den unterstützten Suchmaschinen. Die neue Version ist außerdem stabiler und kann sich von unerwarteten Abstürzen erholen. Vivaldi 7.1 ist für Windows, iOS und Android verfügbar, wobei die Windows-Version bereits zum Download bereitsteht.

Quelle: vivaldi.com/new/

YouTube-Bug sorgt für nicht abschaltbare Werbung, die sogar eine Stunde lang ist

Es gibt einen Fehler bei YouTube, der dazu führt, dass Anzeigen über eine Stunde lang laufen und nicht übersprungen werden können. Nach Angaben von YouTube liegt dies an Werbeblockern, die dazu führen, dass die Werbung nicht korrekt angezeigt wird und die Schaltfläche zum Überspringen verdeckt wird. Normalerweise sind Anzeigen, die nicht übersprungen werden können, bis zu 15 Sekunden lang, im Falle der Smart-TV-App sogar bis zu 60 Sekunden.

YouTube hat Adblocker lange Zeit eingeschränkt und zwingt dich dazu, entweder Werbung zu akzeptieren oder YouTube Premium zu abonnieren. Wer weiterhin Adblocker verwendet, kann mit unerwarteten Problemen konfrontiert werden, wie extrem langen Anzeigen oder der Tatsache, dass sie sich nicht überspringen lassen. Die Ära der bequemen werbefreien YouTube-Nutzung mit Adblockern scheint sich langsam dem Ende zuzuneigen.

Quelle: androidauthority.com/youtube-lang-unskippable-ads-problem-3519957/

Sony beendet die Produktion von Blu-ray Discs nach 18 Jahren

Sony wird in diesem Monat sein letztes Werk schließen, das beschreibbare Blu-ray Discs, MiniDV-Bänder und MD Data-Medien produziert. Dennoch ist die Blu-ray-Technologie noch nicht ganz am Ende – die Produktion von vorbespielten Film- und Spiele-Discs geht weiter, und Sony wird Produktionslinien für Geschäftspartner beibehalten, solange dies wirtschaftlich tragfähig ist. Ursprünglich gewann Blu-ray dank der PlayStation 3 und der Unterstützung der Filmstudios an Bedeutung, tritt jetzt aber angesichts der wachsenden Beliebtheit von Cloud-Diensten und der digitalen Verbreitung von Spielen und Filmen in den Hintergrund.

Optische Disks haben jedoch nach wie vor Vorteile, insbesondere bei der Speicherung großer Datenmengen für die langfristige Datensicherung. Andere Hersteller wie Panasonic, Pioneer, Verbatim und Ritek bleiben auf dem Markt und werden weiterhin beschreibbare Discs produzieren, wenn auch in geringerer Stückzahl. Physikalische Medien werden nicht völlig überflüssig werden, aber ihre Rolle im Verbrauchersegment wird weiter abnehmen.

Quelle: tomshardware.com/pc-components/storage/after-18-years-blu-ray-media-production-draws-to-a-close-sony-shuts-its-last-factory-in-feb

Google Gemini 2.0 kommt – ein neues Modell mit Fokus auf KI-Agenten

Google hat Gemini 2.0 auf den Markt gebracht, die neueste Version seines KI-Modells, das für das „Agentenzeitalter“ entwickelt wurde. Dieses Modell bietet fortschrittliche multimodale Fähigkeiten, einschließlich nativer Bild- und Audiogenerierung, sowie die Integration mit Tools wie der Google-Suche und Codierungsfunktionen. Gemini 2.0 Flash, eine experimentelle Version des Modells, steht Entwicklern bereits über Google AI Studio und Vertex AI zur Verfügung; eine breitere Verfügbarkeit ist für Anfang nächsten Jahres geplant.

Darüber hinaus stellt Google Projekte wie Astra und Mariner vor, die das Potenzial von Echtzeit-KI-Agentensystemen demonstrieren. Das Unternehmen betont sein Engagement für eine verantwortungsvolle KI-Entwicklung, ergreift Sicherheitsmaßnahmen und arbeitet mit externen Experten zusammen, um das Modell zu testen und zu verbessern.

Quelle: blog.google/products/gemini/

EU reguliert KI – neue Verordnung bringt Verbote und Strafen

Die Europäische Union reagiert auf die mit künstlicher Intelligenz (KI) verbundenen Risiken mit einer neuen Verordnung, die den Einsatz von KI in Bereichen verbietet, die als risikoreich gelten. Das Gesetz über künstliche Intelligenz (EU AI Act) trat am 2. Februar 2025 in Kraft und legt strenge Regeln für die Entwicklung und Nutzung von KI in der EU fest.

Das Verbot umfasst manipulative KI-Systeme, die soziale Bewertung von Bürgern, die unadressierte Sammlung von CCTV-Daten und biometrische Analysen an öffentlichen Orten. KI-Systeme dürfen auch nicht zur Überwachung von Emotionen an Arbeitsplätzen oder Schulen eingesetzt werden. Die Verordnung gilt auch für große KI-Modelle (z.B. IBM Granite, Meta Llama 3) und sieht hohe Geldstrafen für Verstöße vor – bis zu 7% des weltweiten Jahresumsatzes eines Unternehmens. Persönliche und wissenschaftliche KI-Systeme sind davon ausgenommen.

Quelle: ibm.com/think/topics/eu-ai-act

Meta sieht sich mit Vorwürfen konfrontiert, raubkopierte Bücher zum Trainieren von KI verwendet zu haben

Meta sieht sich mit Vorwürfen der Urheberrechtsverletzung konfrontiert, nachdem bekannt wurde, dass das Unternehmen raubkopierte Bücher aus Torrents heruntergeladen hat, um seine LLaMA KI-Modelle zu trainieren. Interne E-Mails, die während des Prozesses aufgedeckt wurden, zeigen, dass das Unternehmen etwa 81,7 Terabyte an Daten von Schattenbibliotheken wie LibGen und Z-Library über eine Website namens Anna’s Archive heruntergeladen hat. Einige Mitarbeiter haben Bedenken hinsichtlich der Ethik und Rechtmäßigkeit eines solchen Vorgehens geäußert.

Meta verteidigt sich damit, dass es das Material zwar heruntergeladen, aber Maßnahmen ergriffen hat, um seine weitere Verbreitung (Seeding) während des Torrenting zu verhindern. Das Unternehmen argumentiert auch, dass die Verwendung dieser Daten für das KI-Training unter die „faire Nutzung“ fällt. Die Autoren, darunter Ta-Nehisi Coates und Sarah Silverman, behaupten jedoch, dass Meta wissentlich raubkopierte Versionen ihrer Werke ohne Genehmigung verwendet hat, was eine Urheberrechtsverletzung darstellt. Dieser Fall verdeutlicht auch die wachsenden Spannungen zwischen Urhebern von Inhalten und Tech-Giganten über die Verwendung von geschütztem Material zum Training von KI-Systemen.

Quellen: arstechnica.com/tech-policy/2025/02/meta-torrented-over-81-7tb-of-pirated-books-to-train-ai-authors-say/ und arstechnica.com/tech-policy/2025/02/meta-defends-its-vast-book-torrenting-were-just-a-leech-no proof-of-seeding/

Google schätzt die chinesische KI. DeepSeek beeindruckt mit Effizienz, aber nichts Bahnbrechendes

Der CEO von Google DeepMind, Demis Hassabis, nannte das KI-Modell von DeepSeek „wahrscheinlich die beste Arbeit aus China“. Trotz der überwältigenden Resonanz betonte er jedoch, dass das Modell keinen großen wissenschaftlichen Fortschritt darstellt, da es Techniken verwendet, die auf dem Gebiet der KI bereits bekannt sind. DeepSeek beeindruckte mit der Behauptung, dass es sein Modell zu deutlich geringeren Kosten und auf weniger leistungsstarken Nvidia-Chips trainiert hat, was Debatten über die Effizienz der Ausgaben großer KI-Unternehmen auslöste.

Hassabis warnte jedoch davor, dass diese Kosten tatsächlich höher sein könnten, als das Unternehmen angibt. Er wies auch darauf hin, dass die Gemini 2.0 Flash-Modelle von Google effizienter sind. Die Debatte über künstliche Allgemeine Intelligenz (AGI) gewinnt an Dynamik. Hassabis schätzt, dass sie innerhalb von fünf Jahren eintreffen wird, sodass sich das Unternehmen gründlich auf ihre Auswirkungen vorbereiten muss.

Quelle: cnbc.com/2025/02/09/deepseeks-ai-model-the-best-work-out-of-china-google-deepmind-ceo.html

Google Chrome könnte in Zukunft automatisch unsere Passwörter für uns ändern

Google arbeitet an einer neuen Funktion für Chrome, die die Sicherheit der Nutzer erheblich verbessern könnte. Dabei geht es um die automatische Änderung von Passwörtern, wenn ein Datenleck entdeckt wird. Chrome würde Informationen über Sicherheitsvorfälle verfolgen und im Falle einer Kontoverletzung eine Option zur sofortigen Passwortänderung anbieten. Dieser Prozess wäre vollständig automatisiert und würde den aktuellen Passwortmanager von Google ergänzen. Die Nutzer müssten ihre Passwörter nicht manuell ändern – Chrome würde dies für sie übernehmen. Die neue Funktion befindet sich noch in der Entwicklung und es ist nicht bekannt, wann sie für die Öffentlichkeit verfügbar sein wird.

Quelle: androidheadlines.com/2025/02/google-chrome-change-passwords-automatically.html

OpenAI bereitet neue Modelle vor – GPT-4.5 Orion kommt bald, GPT-5 später

OpenAI bereitet neue Versionen von Sprachmodellen vor. Sam Altman kündigte an, dass GPT-4.5 Orion in ein paar Wochen erscheinen wird und das letzte Modell sein wird, das den vorherigen Kontext nicht berücksichtigt.

GPT-5 wird bedeutende Verbesserungen bringen, wie z.B. ein erweitertes Kontextfenster und multimodale Funktionen, die es dir ermöglichen, mit Text, Bildern und Audio zu arbeiten. Es wird in ein paar Monaten erwartet. OpenAI plant außerdem, Modelle mit dem „o“-Attribut zu verschmelzen. Nicht zahlende Nutzer werden Zugang zu GPT-5 erhalten, wenn auch mit eingeschränkten Funktionen. Die kostenpflichtige Pro-Version wird erweiterte Funktionen bieten, wie z.B. unbegrenzte Sprachinteraktion und erweiterte Funktionen im Sora Video-Erstellungstool.

Quelle: com/sama/status/1889755723078443244

Windows 11 verbessert das Snap-Panel – ein praktischeres Fensterlayout

Microsoft plant Verbesserungen für die Funktion „Snap“ in Windows 11, mit der du Fenster auf dem Bildschirm schnell anordnen kannst. Die neue schwebende Leiste wird klarer dargestellt und Microsoft möchte die Verwendung des Tastaturkürzels Win+Z fördern, der bisher nicht von allen genutzt wird. Die Änderungen sind in der Insider Preview Build 22635.4805 enthalten. Das Einrasten von Fenstern hat sich von einer einfachen Funktion in Windows 7 zu den aktuellen Anpassungsoptionen für den halben oder viertel Bildschirm entwickelt. Nutzer können Fenster nicht nur mit der Maus, sondern auch mit der Windows-Tastenkombination + linke/rechte Pfeiltasten für effizienteres Multitasking anordnen.

Quelle: blogs.windows.com/windows-insider/2025/01/24/announcing-windows-11-insider-preview-build-22635-4805-beta-channel/

Tomb Raider IV-V-VI Remastered – Lara Croft kehrt in neuem Gewand zurück

Die Remastered-Versionen der nächsten drei Tomb Raider-Episoden sind da und bieten eine verbesserte Grafik, neue Funktionen und ein originalgetreues Gameplay. Die Spieler können mit einem einzigen Druck auf die F1-Taste zwischen der alten und der neuen Grafik wechseln.

Die Spiele behalten die klassische Steuerung bei, bieten aber auch ein modernisiertes Schema für ein komfortableres Gameplay. Von Anfang an planten die Entwickler von Aspyr Media ein Remaster der gesamten sechsteiligen Serie von Core Design. Zu den Verbesserungen gehören eine neu gestaltete Beleuchtung, eine bessere Sichtbarkeit von Objekten und die Möglichkeit, die Gesundheit der Bosse anzuzeigen. Die Spieler können sich auch auf den Bonuslevel „Times Exclusive“ freuen, den viele Fans der Originalspiele noch nicht gespielt haben.

Quelle: rockpapershotgun.com/tomb-raider-iv-vi-remastered-review

Kingdom Come: Deliverance II – das beste historische RPG?

Kingdom Come: Deliverance II ist die Fortsetzung des erfolgreichen historischen Rollenspiels des tschechischen Studios Warhorse Studios und wurde am 4. Februar 2025 für PlayStation 5, Windows und Xbox Series X/S veröffentlicht. Das Spiel spielt im mittelalterlichen Böhmen des 15. Jahrhunderts und folgt der Geschichte von Henry, dem Sohn eines Schmieds aus Skalica, der sich nur zwei Tage nach dem Ende des ersten Teils erneut in ein episches Abenteuer stürzt.

Das Spiel hat überwiegend positive Kritiken erhalten, mit einer durchschnittlichen Bewertung von 88 % auf Metacritic und sogar 92 % von über 40.000 Spielern auf Steam. Die Kritiker loben die realistische Darstellung der mittelalterlichen Welt, die detaillierten Umgebungen und die tiefgründige Geschichte. Die Website Dexerto gab dem Spiel eine volle 5/5-Bewertung und lobte die wunderschöne offene Welt und das verbesserte Kampfsystem. Auch Windows Central vergab 5/5 und hob die hervorragenden Kämpfe und unerwarteten Wendungen in der Geschichte hervor.

Das Spiel war auch kommerziell erfolgreich und verkaufte sich bereits am ersten Tag mehr als eine Million Mal. Nach drei Wochen waren bereits über 2,5 Millionen Exemplare verkauft. Dieser Erfolg bestätigt das große Interesse der Spieler an hochwertigen historischen RPGs.

Kingdom Come: Deliverance II bietet den Spielern eine riesige offene Welt, in der die tschechische Landschaft originalgetreu nachgebildet ist, darunter Gebiete wie das Böhmische Paradies, die Burg Trosky und die Stadt Kutná Hora. Die Betonung der realistischen Spielmechanik, bei der die Spieler auf die Bedürfnisse ihrer Charaktere wie Schlaf, Ernährung und Hygiene achten müssen, trägt zu einem tieferen Eintauchen in das mittelalterliche Leben bei.

Kingdom Come: Deliverance II gilt als bedeutender Beitrag zum RPG-Genre, da es historische Genauigkeit mit einer fesselnden Geschichte und komplexen Spielmechanismen verbindet.

Quelle: indian-tv.com/reviews/andere-dil-ist-das-beste-das-zu-erledigen-kommt-kvv307

Januar 2025

Kostenlose Websuche mit ChatGPT für alle Benutzer

ChatGPT ermöglicht jetzt allen Nutzern die Suche im Internet, was seine Fähigkeit, umfassende Antworten zu geben, erheblich verbessert. Die Funktion, die bisher nur ChatGPT Plus-Abonnenten oder Nutzern mit vorrangigem Zugang zur Verfügung stand, ermöglicht es dem Chatbot nun, nach Informationen auf Websites, in sozialen Netzwerken oder auf YouTube zu suchen. Die Benutzer können diese Quellen über die vom Chatbot bereitgestellten Links überprüfen. Diese Neuerung ist besonders im akademischen Umfeld nützlich, da sie Studenten den Zugang zu verifizierten Quellen erleichtert.

Die Funktion ist sowohl in der Web- als auch in der mobilen Benutzeroberfläche verfügbar und kann durch Klicken auf das Globussymbol neben der Suchleiste aktiviert werden. ChatGPT bietet somit neue Möglichkeiten für die Arbeit mit Informationen, unabhängig davon, ob der Nutzer ein Abonnement hat.

Quelle: theverge.com/2024/12/16/24322665/chatgpt-search-engine-rolling-out-free-users

Elon Musk bereitet Xmail vor – ein neuer E-Mail-Client mit interessanten Funktionen

Elon Musk, der für seine ehrgeizigen Technologieprojekte bekannt ist, plant, einen neuen E-Mail-Client namens Xmail vorzustellen. Dieser soll eine einfache und freundliche Umgebung bieten, die mit Googles dominantem Gmail konkurrieren könnte. Xmail wurde auf Platform X (ehemals Twitter) erwähnt, wo Musk auf den Wunsch eines Benutzers nach einem weniger formellen und weniger komplizierten E-Mail-System reagierte. Obwohl konkrete Details und ein Starttermin noch nicht bekannt gegeben wurden, soll Xmail einzigartige Funktionen bieten, die Nutzer anziehen könnten.

Der Erfolg von Xmail wird von seiner Fähigkeit abhängen, revolutionäre Innovationen zu liefern, die die langjährigen Gewohnheiten der Gmail-Nutzer überwinden. Eine verlockende Funktion könnte die Möglichkeit sein, kürzere E-Mail-Adressen in Form von nutzer@x.com zu verwenden, was Technikbegeisterte ansprechen könnte. Der Ehrgeiz von Musk, Google zu entthronen, zeigt, dass er auch für die E-Mail-Kommunikation große Pläne hat.

Quelle: androidheadlines.com/2024/12/elon-musk-hints-at-working-on-xmail-a-new-dm-style-email-service.html

Qualcomm setzt sich im Streit mit ARM durch

Qualcomm hat in einem Rechtsstreit mit ARM über Lizenzvereinbarungen nach der Übernahme des Startups Nuvia im Jahr 2021 einen wichtigen Sieg errungen. Ein US-Bundesgericht entschied, dass Qualcomm nicht gegen die Lizenzvereinbarungen verstoßen hat, sodass das Unternehmen weiterhin Chips auf Basis der Nuvia-Technologie entwickeln und verkaufen darf. Das Urteil ist jedoch nicht abschließend, da Fragen zu Lizenzgebühren und Rechtsansprüchen von ARM offen bleiben.

Diese Kontroverse ist von großer Bedeutung für die Zukunft der Chips von Qualcomm, insbesondere für das neue Flaggschiffprodukt Snapdragon 8 Elite mit Oryon-Kernen, welches die von Nuvia entwickelte Phoenix-Architektur verwendet. Damit könnte Qualcomms Expansion auf dem Markt für KI-fokusierte Computerchips vorangetrieben werden, aber die Androhung weiterer rechtlicher Schritte seitens ARM könnte die langfristige Entwicklung der Technologie beeinträchtigen.

Quelle: reuters.com/legal/us-jury-deadlocked-arm-trial-against-qualcomm-still-deliberating-2024-12-20/

Instagram bringt die lang erwartete Funktion zur Nachrichtenplanung

Instagram, das sich von einer Foto-Sharing-Plattform zu einem umfassenden sozialen Netzwerk entwickelt hat, führt endlich eine Funktion ein, nach der die Nutzer seit Jahren gefragt haben – die Möglichkeit, Nachrichten zu planen. Du kannst jetzt eine Nachricht verfassen und deren Versand bis zu 29 Tage im Voraus planen. Diese Funktion ist perfekt für diejenigen, die keine Nachrichten zu ungünstigen Zeiten versenden möchten oder für diejenigen, die Erinnerungen setzen müssen, ohne sich Sorgen machen zu müssen, sie zu vergessen.

Die Terminierung von Nachrichten ist sowohl auf Android-Geräten als auch auf iPhones verfügbar. Halte einfach die Taste zum Senden der Nachricht gedrückt, wähle das Datum und die Uhrzeit aus der Bildlaufleiste aus und schon ist die Nachricht versandfertig. Du kannst eine geplante Nachricht jederzeit über eine Benachrichtigung in der Konversation bearbeiten oder abbrechen. Diese neue Funktion, die zu den Silvesterfunktionen von Instagram gehört, macht es einfach, Weihnachtswünsche oder andere wichtige Nachrichten stressfrei und in letzter Minute vorzubereiten.

Quelle: businesstoday.in/technology/news/story/instagram-launches-dm-scheduling-feature-letting-users-plan-messages-up-to-29-days-ahead-457687-2024-12-18

Die Europäische Union hat die Verwendung des USB-C-Steckers zur Pflicht gemacht

Die Europäische Union hat die EU-Richtlinie 2022/2380 eingeführt, die vorschreibt, dass alle neuen Geräte auf dem EU-Markt ab dem 28. Dezember 2024 einen USB-C-Ladeanschluss verwenden müssen. Diese Entscheidung soll die Verwendung von Ladegeräten vereinfachen und den Elektroschrott reduzieren. Die Verordnung gilt nicht nur für Smartphones, sondern auch für Tablets, E-Book-Reader, Computerperipheriegeräte und Kopfhörer. Die meisten Smartphones verwenden bereits USB-C, und Apple hat seine neuen iPhones an den Standard angepasst. Laptops haben eine längere Übergangsfrist und müssen erst ab dem 28. April 2026 das Laden über den USB-C-Anschluss unterstützen. Trotz der weiten Verbreitung von USB-C bleiben Fragen zur Kompatibilität und Leistung von Ladegeräten bestehen, da neue Geräte oft superschnelles Laden unterstützen, was den Kauf von zusätzlichem Zubehör erfordern kann. Der Schritt wird jedoch als wichtiger Schritt hin zu einer grüneren und benutzerfreundlicheren Technologieumgebung gesehen.

Quelle: commission.europa.eu/news/eu-common-charger-rules-power-all-your-devices-single-charger-2024-12-28_de

OpenAI bringt ein neues o3-Modell für ChatGPT auf den Markt

ChatGPT wird ein neues Modell namens o3 einführen, von dem erwartet wird, dass es das Niveau einer künstlichen allgemeinen Intelligenz (AGI) erreicht. Das bedeutet, dass es menschliche Fähigkeiten in vielen Bereichen übertreffen könnte. Das Modell wird in verschiedenen Versionen erhältlich sein, darunter o3 und o3-mini. Es ist der Nachfolger der o1-Modelle und überspringt die o2-Version, um Markenkonflikte mit dem britischen Anbieter O2 zu vermeiden. Die Veröffentlichung ist für Ende Januar 2025 geplant.

Das neue Modell legt den Fokus auf Präzision und Begründung der Ergebnisse, besonders in Mathematik, Physik und Naturwissenschaften. Interessanterweise zeigten Tests, dass das o3-Modell beim Halluzinieren (falsche Aussagen generieren) überzeugender wirkt. Dies ist Teil einer Optimierung, die Effizienz und Genauigkeit der Antworten ausbalanciert. Die o3-Version ermöglicht dir außerdem, die Zeit anzupassen, die das Modell für seine „Argumentation“ verwendet, um so unterschiedlichen Bedürfnissen gerecht zu werden.

Quelle: techcrunch.com/2024/12/20/openai-announces-new-o3-model/

Facebook streicht Faktenchecks – Meinungsfreiheit oder mehr Fehlinformationen?

Facebook (Meta) hat angekündigt, sein Faktencheck-Programm einzustellen, das bisher den Wahrheitsgehalt von Beiträgen überprüfte. Laut Mark Zuckerberg soll dies die Meinungsfreiheit stärken, da die Algorithmen oft legitime Inhalte fälschlich zensiert hätten. Die Faktenchecks werden durch Community Notes ersetzt, ähnlich wie bei Network X (früher Twitter). Die Einstellung der Zusammenarbeit mit Journalisten und Organisationen wie PolitiFact könnte jedoch zu mehr Fehlinformationen und Betrug führen.

Die Entscheidung folgt auf Kritik der Vergangenheit, etwa von Donald Trump, der Facebook vorwarf, sich in Wahlen einzumischen. Experten warnen, dass dies die Verbreitung von Fake News und Propaganda verstärken könnte, was Auswirkungen auf Wahlen und globale Ereignisse hätte. Während das Programm in den USA ausläuft, wird erwartet, dass ähnliche Änderungen schrittweise auf andere Länder – einschließlich der Slowakei – ausgeweitet werden.

Quelle: tampabay.com/news/florida-politics/2025/01/07/meta-ending-third-party-fact-checking-partnership-with-us-partners/

Microsoft Office beendet Updates für Windows 10

Microsoft hat bestätigt, dass der Support für Microsoft 365-Apps auf Windows 10 am 14. Oktober 2025 endet. Dies ist auch das offizielle Support-Ende für Windows 10 selbst. Danach funktionieren die Office-Apps und das System zwar weiter, erhalten aber keine Updates mehr, was sie langfristig anfälliger für Sicherheitslücken machen könnte.

Microsoft empfiehlt Nutzern dringend, auf Windows 11 umzusteigen, das als stabiler und sicherer gilt. Einige Nutzer könnten jedoch Kompatibilitätsprobleme haben, vor allem aufgrund der Anforderungen an Prozessor und TPM 2.0-Chip. Zwar gibt es derzeit noch Umgehungsmöglichkeiten, doch das Unternehmen plant, diese in Zukunft zu erschweren.

Quelle: support.microsoft.com/en-us/office/what-windows-end-of-support-means-for-office-and-microsoft-365-34e28be4-1e4f-4928-b210-3f45d8215595

PC-Markt wächst 2024 nur mäßig

Das Jahr 2024 brachte ein moderates Wachstum von 1,3 % für die PC-Branche, mit einer Gesamtauslieferung von 245,3 Millionen Geräten. Trotz der Bemühungen der Hersteller, neue Technologien wie KI und Windows 11 voranzutreiben, wird der Markt weiterhin von dem Abschwung nach der Pandemie überschattet. Die größten Gewinner sind Asus, Lenovo und Apple, die ihre Marktanteile am stärksten steigern konnten. Dagegen mussten HP und Dell leichte Rückgänge hinnehmen.

Obwohl das Marketing für KI-fähige Laptops und die Snapdragon-Plattform Fortschritte gemacht hat, ist das Interesse der Verbraucher an diesen Funktionen bisher eher gering. Microsoft und Google versuchen, die Attraktivität durch die Integration von KI in die Software zu erhöhen, sind dabei aber nicht wesentlich vorangekommen. Der PC-Markt erwartet daher erst im Jahr 2025 mehr Schwung, wenn Innovationen und die Öffnung von Windows on Arm für neue Chip-Plattformen den erwarteten Schub bringen könnten.

Quelle: gartner.com/de/newsroom/press-releases/2025-01-15-gartner-says-worldwide-pc-shipments-increased-1-point-4-percent-in-fourth-quarter-of-2024

Android 16 kommt – neue Multitasking-Funktionen auf Tablets

Google bereitet Android 16 mit Baklava vor, das voraussichtlich im zweiten Quartal 2025 veröffentlicht wird und bereits im März Plattformstabilität erreicht. Eine wichtige Neuerung wird das verbesserte Multitasking für Tablets sein, mit dem bis zu drei Apps gleichzeitig auf einem einzigen Bildschirm angezeigt werden können. Diese Funktion wird die Nutzung großer Bildschirme erheblich verbessern, die bisher nur von Geräten mit eigenen Add-Ons, wie z.B. Samsung Galaxy Tablets, voll ausgeschöpft werden konnte.

Das neue flexible Multitasking-System, das bereits in der Android 16 Developer Preview 2 verfügbar ist, soll die komfortable Anzeige von Apps auf größeren Displays unterstützen. Das Android 16 Beta-Programm, das für diesen Monat geplant ist, könnte weitere Details enthüllen. Die Funktion zielt darauf ab, die Produktivität und den Komfort für Nutzer von Tablets und faltbaren Geräten zu erhöhen.

Quelle: 9to5google.com/2025/01/16/android-16-split-screen-mode-tablets-upgrade-rumor/

TSMC eröffnet erste Halbleiterfabrik in den USA